28 januari 2026 · 5 min read

Het juiste transcriptiemodel vinden: Kijk naar deze acht factoren

Als doctoraatsonderzoeker moet ik regelmatig interviews en vergaderingen verwerken. Ik merkte al snel dat populaire, standaard transcriptiesoftware – zoals de ingebouwde transcriptiefunctie van Microsoft Word – teleurstellende resultaten leveren. Hierdoor ben ik veel beginnen nadenken over spraak-naar-teksttechnologie. In dit blogbericht deel ik graag een aantal belangrijke inzichten die ik heb opgedaan bij het kiezen van het juiste model, en waarom ik uiteindelijk besloten heb een benchmark- en transcriptietool te ontwikkelen die deze complexiteit afhandelt, zodat jij dat niet moet doen.

Wat er echt toe doet bij het kiezen van een spraak-naar-tekstmodel

Bij het vergelijken van STT-modellen zijn er veel dingen om over na te denken. Deze elementen maken naar mijn ervaring echt een verschil:

- Nauwkeurigheid: Dat is natuurlijk de belangrijkste vraag. Het is meestal het eerste waar mensen naar vragen, en terecht. Over het algemeen geldt: hoe nauwkeuriger een model is, hoe meer je ervoor betaalt. Maar er is een punt: zelfs de beste modellen garanderen geen 100% nauwkeurigheid. Afhankelijk van hoe precies je transcriptie moet zijn, zul je achteraf nog wat bewerkingen moeten uitvoeren.

- Snelheid: "latency" is erg belangrijk als je iets doet waarbij tijd een cruciale factor is, zoals live ondertiteling of het bouwen van een spraakassistent. Het geeft namelijk aan hoe snel het model je audio kan verwerken en de transcriptie kan leveren.

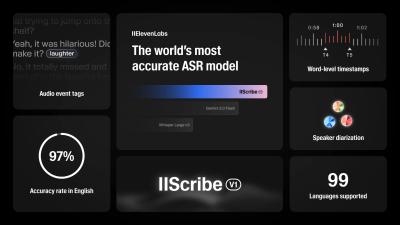

- Kwaliteit van de sprekerherkenning: "speaker diarization" is de chique term voor hoe goed een model verschillende sprekers van elkaar kan onderscheiden. Als je vergaderingen of interviews met meerdere mensen transcribeert, moet dit goed werken. Anders ben je eindeloos bezig met uitzoeken wie wat gezegd heeft.

- Taalondersteuning: Dit varieert enorm. Op het moment van schrijven ondersteunt Gladia bijna honderd talen, Deepgram heeft verschillende modellen met verschillende taaldekking en Speechmatics verwerkt vijfenveertig talen met een hoge nauwkeurigheid. Daar komt nog bij dat dialecten binnen een taal sterk van elkaar kunnen verschillen qua klank of specifieke woorden of zinsneden. Niet elk model presteert even goed op het ene dialect als op een ander dialect binnen dezelfde taal.

- Verbatim: Dan is er nog de kwestie van letterlijke weergave versus leesbaarheid. Soms wil je elke "uh" en "ah" exact zoals hij is uitgesproken. Andere keren wil je een opgeschoonde versie die prettig leesbaar is.

- Meertalige audio: Een moeilijkheid voor veel modellen. Als je werkt met gesprekken waarbij mensen wisselen tussen talen – bijvoorbeeld Frans, Engels en Nederlands in dezelfde vergadering – heb je een model nodig dat daar soepel mee om kan gaan.

- Privacy en gegevenslocatie: Dit kan, afhankelijk van je situatie, doorslaggevend zijn. Sommige modellen (zoals Whisper van OpenAI of Voxtral van Mistral) kan je u op je eigen computer uitvoeren, wat goed is voor de privacy. Bij API-diensten kan het van belang zijn of de servers zich in Europa bevinden.

- En tot slot, aangepaste woordenschat. De mogelijkheid om specifieke productnamen, technisch jargon of eigennamen toe te voegen, kan een enorm verschil maken in de nauwkeurigheid van specialistische content.

De verschillende "model providers"

Het STT-landschap is behoorlijk divers. Aan de commerciële kant heb je gevestigde spelers zoals Speechmatics, Deepgram, Sonix, Gladia en Assembly, plus de grote techbedrijven - Google en Microsoft - met hun cloud-geïntegreerde oplossingen. ElevenLabs Scribe is een andere, recentere, degelijke optie. Deze grote commerciële modellen bieden doorgaans een hoge nauwkeurigheid, veel functies en de infrastructuur om te schalen.

Op het gebied van open-source is Whisper waarschijnlijk de bekendste. Het Franse AI-bedrijf Mistral heeft ook een uitstekend open-source model genaamd Voxtral. Het grote voordeel hiervan is dat je deze op je eigen hardware kunt draaien, wat zowel privacyvriendelijk is als de doorlopende API-kosten elimineert.

Waarom ik Scribewave heb gebouwd

Het probleem waar ik steeds tegenaan liep, was dit: het bijhouden van al die modellen is uitputtend. Er komen elke week nieuwe uit. Elk model heeft zijn eigen sterke en zwakke punten. Het testen van al die modellen met jouw specifieke audio-omstandigheden – achtergrondgeluid, accenten, audiokwaliteit – kost een eeuwigheid. En eerlijk gezegd willen de meeste mensen gewoon dat hun audio nauwkeurig wordt getranscribeerd. Ze willen geen experts in spraak-naar-tekstverwerking worden.

Daarom heb ik Scribewave ontwikkeld. Het idee is om al die complexiteit weg te nemen en je gewoon de meest accurate transcriptie te garanderen.

We vergelijken continu twaalf verschillende modellen met elkaar, inclusief onze eigen en diverse commerciële opties. Wanneer er nieuwe modellen verschijnen (wat in de huidige AI-race heel vaak gebeurt), testen we ze en werken we onze benchmarks automatisch bij.

Wanneer je een bestand uploadt naar Scribewave, kun je eenvoudig je specifieke wensen aangeven.Heeft u een aangepaste woordenschat nodig? Is het meertalig? Wilt u letterlijke of leesbare tekst? Op basis van uw instellingen en de kenmerken van uw audio – zoals achtergrondgeluid of dialect – kiezen we automatisch het beste model voor dat specifieke bestand. U hoeft zich geen zorgen te maken of Elevenlabs, Speechmatics of Deepgram beter werkt. We hebben ze allemaal al getest en weten welke de beste resultaten oplevert.

Meer dan alleen transcriptie

Maar Scribewave gaat niet alleen over het kiezen van het juiste model. Ik heb een complete workflowtool gebouwd:

- De editor: Hiermee kun je elk woord corrigeren, en alles blijft perfect gesynchroniseerd met de audio. Je kunt door het transcript scrollen terwijl de audio wordt afgespeeld, woorden toevoegen of verwijderen, correcties aanbrengen, en dat alles met behoud van die synchronisatie.

- Vertalingen zijn direct ingebouwd. Vertaal je transcript naar een andere taal en het blijft gesynchroniseerd met de originele audio. Je kunt de vertaling ook bewerken.

- De AI-assistent: Het programma kan je gecorrigeerde transcript analyseren en vragen erover beantwoorden, wat ontzettend handig is om inzichten te verkrijgen uit lange gesprekken of vergaderingen. Het kan je transcript ook opschonen om het leesbaarder te maken, terwijl je de mogelijkheid behoudt om terug te schakelen wanneer dat nodig is.

- Verschillende exportopties - Word-documenten, diverse formaten, alles wat je nodig hebt om in je bestaande workflow te passen.

Mensen vragen me wel eens waarom ik een transcriptieservice ontwikkel terwijl al die grote bedrijven al actief zijn op dit gebied. Mijn antwoord is dat een goede transcriptie zo afhankelijk is van de specifieke audio-omstandigheden en voorkeuren, dat het erg moeilijk is om met hetzelfde model elke keer het beste resultaat te behalen. Bovendien wil je meestal iets met de transcriptie doen – bewerken, vertalen, analyseren – om maar een paar voorbeelden te noemen.

Met Scribewave draait het hierom: je hoeft je geen zorgen te maken over modelselectie, instellingen of de nieuwste ontwikkelingen op het gebied van spraak- en teksttranscriptie. Upload je bestand en Scribewave doet de rest. Je krijgt zo snel mogelijk een nauwkeurig transcript en kunt je concentreren op het daadwerkelijke gebruik ervan in plaats van te worstelen met de technologie.

Over de auteur

Ulysse Maes

In een wereld waar Ulysse niet sterker kan zijn dan The Rock of charmanter dan Timothée Chalamet, triomfeert hij als het meesterbrein achter Scribewave. Hij verdedigt zo fier zijn troon als de koning van de nerds in "'t Stad", Antwerpen, België.

Gerelateerde artikelen

Ontdek meer artikelen over transcriptie, ondertiteling en vertaling