9 avril 2025 · 7 min read

OpenAI lance GPT-4o-Transcribe : un modèle de transcription puissant mais limité

Dans une annonce discrète, OpenAI a présenté deux nouveaux modèles de conversion de la parole en texte qui surpassent leur prédécesseur, Whisper V3, dans plusieurs langues. Ces nouveaux modèles, gpt-4o-transcribe et gpt-4o-mini-transcribe, enrichissent le portefeuille de modèles audio toujours plus performants d'OpenAI, mais présentent des limitations importantes que les utilisateurs potentiels doivent prendre en compte.

Les avancées discrètes d'OpenAI dans la technologie audio

Alors qu'OpenAI fait régulièrement la une des journaux avec ses sorties LLM et les mises à jour de son générateur vidéo Sora, ses développements audio sont souvent annoncés plus discrètement (peut-être parce qu'ils ont peur qu'une trop grande publicité puisse susciter des inquiétudes concernant le matériel protégé par le droit d'auteur utilisé pour la formation). Malgré ce profil plus discret, la société a progressivement construit un portefeuille impressionnant de technologies audio, notamment en matière de synthèse vocale (TTS) avec des résultats remarquablement naturels.

Le dernier ajout à cet écosystème audio en pleine croissance est leur nouvelle API de transcription à source fermée (STT) de marque gpt-4o, qui représente une amélioration substantielle par rapport à leur modèle précédent Whisper V3, mais arrive avec beaucoup moins de publicité que leurs autres lancements récents, dans un article de blog sur leur site.

Les nouvelles offres se composent de deux modèles automatiques de conversion de la parole en texte à source fermée :

- gpt-4o-transcribe:Le plus puissant et le plus précis des deux modèles

- gpt-4o-mini-transcribe:Une alternative plus légère qui équilibre performance et efficacité

Ces modèles sont disponibles via l'API d'OpenAI à un prix relativement abordable, ce qui rend la transcription précise plus accessible aux développeurs.

Comment se comparent-ils à Whisper ?

Whisper d'OpenAI a été largement adopté comme solution de transcription open source, mais ces nouveaux modèles revendiquent des performances supérieures dans la plupart des langues. Cependant, les améliorations varient considérablement selon la langue.

Nous constatons que la plupart des améliorations concernent des langues auparavant faibles. Par exemple, la reconnaissance vocale avec la famille gpt-4o du malayalam présente des taux d'erreurs de mots (WER) nettement inférieurs à ceux de Whisper. Pour les langues où Whisper était déjà performant, on observe également une certaine amélioration, mais les gains relatifs sont plus modestes.

Cette amélioration inégale suggère qu'OpenAI s'est concentré sur la correction des points faibles de Whisper plutôt que sur des améliorations uniformes pour tous les langages, et semble confirmer la « loi des rendements décroissants ». La plupart des modèles de langages semblent s'améliorer asymptotiquement jusqu'à atteindre une quasi-perfection, sans être totalement irréprochable.

Paysage concurrentiel

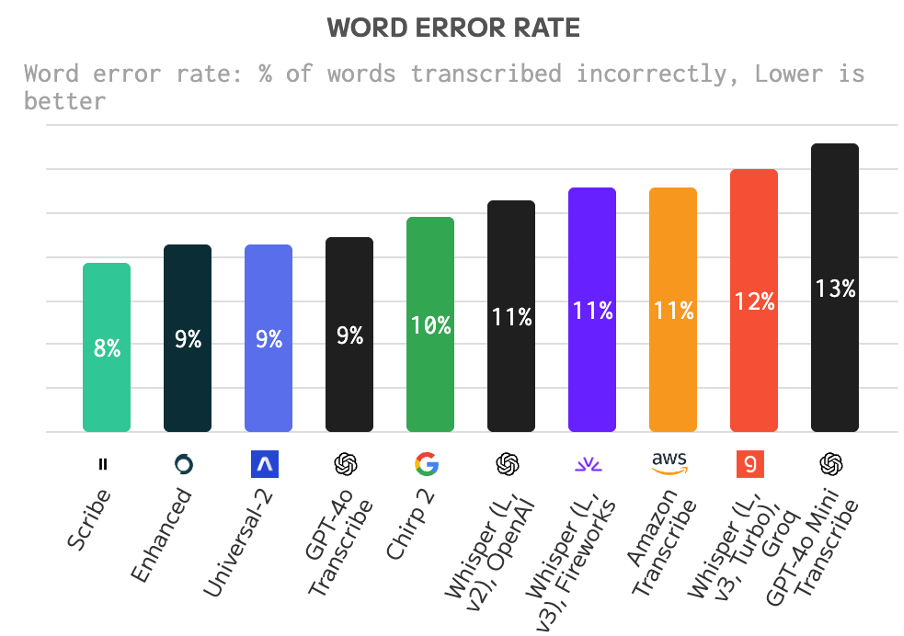

L'espace de transcription est de plus en plus compétitif, avec Gemini de Google API offrant des fonctionnalités similaires, bien que leur modèle de langage Gemini soit nativement multimodal. Benchmarks indépendants réalisés par Analyse artificielle confirment que gpt-4o-transcribe se comporte admirablement bien face aux leaders du secteur, occupant une deuxième place combinée aux côtés de Speechmatics et Assembly, se situant à seulement un point de pourcentage derrière Scribe.

Prix versus performance

L'un des atouts majeurs de ces nouveaux modèles réside dans leur structure tarifaire : gpt-4o-mini-transcribe est proposé à la moitié du prix du point de terminaison Whisper d'OpenAI. Seules les versions hébergées de Whisper V3 de Groq et Fireworks sont proposées à un prix inférieur. Cette tarification compétitive en fait une option attractive pour les développeurs déjà présents dans l'écosystème OpenAI.

Limites importantes à prendre en compte

Malgré des indicateurs de performance impressionnants, plusieurs limitations importantes peuvent empêcher gpt-4o-transcribe de devenir la solution de référence pour de nombreux cas d'utilisation :

- Limitations d'accès: Actuellement, le modèle n'est accessible que viacode, sansinterface convivialepour l'essayer.

- Restrictions de taille de fichier: Les téléchargements de fichiers vers l'API audio OpenAI sont limités aux fichiers de moins de 25 Mo, ce qui signifie que vous ne pouvez pas transcrire des fichiers audio ou vidéo plus longs.

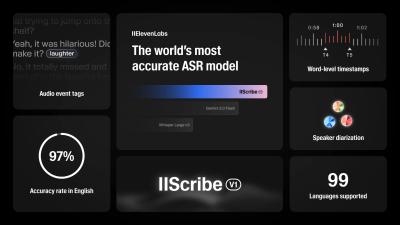

- Fonctionnalités manquantes:Il manque des fonctionnalités essentielles comme les horodatages au niveau des mots ou la reconnaissance du locuteur (diarisation)

- Nature de source fermée:Comme les nouveaux modèles sont – contrairement à Whisper – open source, ils n'offrent pas d'options de personnalisation pour des domaines ou des vocabulaires spécifiques

- Préoccupations relatives à la confidentialité:OpenAI peut utiliser des données téléchargées pour former son modèle, ce qui soulève des problèmes de confidentialité, en particulier pour les utilisateurs européens.

Bien que Whisper offre davantage de personnalisation en raison de sa nature open source, la version hébergée d'OpenAI souffre également du même ensemble limité de fonctionnalités et de la même petite taille de fichier maximale.

Est-ce adapté à vos besoins ?

Que gpt-4o-transcribe soit le bon choix dépend entièrement de vos besoins spécifiques :

- Pour les développeurs qui construisent au sein de l'écosystème OpenAI: gpt-4o-mini-transcribe offre un excellent rapport qualité-prix et des performances solides

- Pour les utilisateurs non techniques à la recherche d'une solution complète: Suites de transcription complètes comme Scribewave offrir une expérience plus accessible et riche en fonctionnalités

Voici quelques exemples d'utilisation de Scribewave:

- Une précision encore plus élevée sur 32 langues, selon les benchmarks

- Un niveau gratuit avec une interface conviviale est disponible pour les tests

- Il prend en charge le téléchargement de fichiers audio et vidéo volumineux, d'une durée de plusieurs heures

- Il reconnaît différents haut-parleurs dès la sortie de la boîte

- Scribewave renvoie des résultats joliment formatés avec plusieurs options d'exportation, telles que Word, Google Docs et divers formats de sous-titres

Conclusion

Les nouveaux modèles de transcription d'OpenAI représentent des avancées impressionnantes en matière de précision de transcription, notamment dans les langues jusqu'alors mal desservies. Cependant, leur utilité est limitée par des limitations pratiques qui les rendent inadaptés à de nombreuses applications concrètes.

Si vous êtes un développeur utilisant déjà les outils OpenAI et recherchez des fonctionnalités de transcription économiques, gpt-4o-mini-transcribe offre un excellent rapport qualité-prix. En revanche, si vous recherchez une solution de transcription complète et conviviale, avec des fonctionnalités telles que la reconnaissance du locuteur et des options d'exportation flexibles, des alternatives comme Scribewave seraient plus adaptées.

À mesure que l’espace de transcription continue d’évoluer, nous pouvons nous attendre à de nouvelles améliorations pour répondre à ces limitations, mais pour l’instant, les utilisateurs doivent soigneusement faire correspondre leurs besoins spécifiques aux capacités et aux contraintes de chaque solution disponible.

À propos de l'auteur

Ulysse Maes

Dans un monde où Ulysse ne peut rivaliser ni avec la musculature de The Rock, ni avec le charme de Timothée Chalamet, il triomphe en tant que cerveau derrière Scribewave, défendant farouchement son trône de roi des nerds dans la magnifique ville d'Anvers, en Belgique.

Articles connexes

Découvrir plus